Trang tin công nghệ

So sánh GPU dùng cho AI NVIDIA vs AMD

Trong kỷ nguyên AI đang phát triển nhanh chóng, GPU (Graphics Processing Unit – Bộ xử lý đồ họa) đóng vai trò then chốt trong việc tăng tốc các tác vụ đòi hỏi nhiều tính toán, từ huấn luyện mô hình học sâu đến triển khai suy luận AI. Hai “ông lớn” trong lĩnh vực sản xuất GPU là NVIDIA và AMD đều cung cấp các giải pháp phần cứng mạnh mẽ, nhưng mỗi hãng có những ưu điểm và nhược điểm riêng khi nói đến ứng dụng AI. Bài viết này sẽ đi sâu vào so sánh GPU của NVIDIA và AMD trong bối cảnh AI, giúp người đọc có cái nhìn tổng quan và đưa ra lựa chọn phù hợp nhất cho nhu cầu của mình.

Hiểu rõ về GPU Acceleration trong AI

GPU acceleration (tăng tốc bằng GPU) đã trở thành một yếu tố thiết yếu trong AI và High-Performance Computing (HPC), cho phép các kỹ sư phần mềm khai thác sức mạnh xử lý song song của GPU để thực hiện các tác vụ vượt xa khả năng của việc render đồ họa truyền thống. NVIDIA và AMD đều phát triển các nền tảng tăng tốc GPU mạnh mẽ – CUDA của NVIDIA và ROCm của AMD – để đáp ứng nhu cầu ngày càng tăng của AI và HPC.

Phần 1: Tổng quan về NVIDIA và AMD trong lĩnh vực AI

NVIDIA: “Ông Vua” với hệ sinh thái toàn diện

NVIDIA đã xây dựng được vị thế dẫn đầu vững chắc trong thị trường GPU cho AI nhờ kiến trúc phần cứng mạnh mẽ và hệ sinh thái phần mềm CUDA (Compute Unified Device Architecture).

- CUDA: CUDA là một nền tảng điện toán song song và API lập trình độc quyền của NVIDIA, cho phép các nhà phát triển khai thác sức mạnh tính toán của GPU NVIDIA cho các ứng dụng khác. CUDA đã trở thành một tiêu chuẩn vàng trong lĩnh vực AI, với hầu hết các thư viện và framework AI hàng đầu như TensorFlow và PyTorch đều được tối ưu hóa sâu sắc cho kiến trúc NVIDIA.

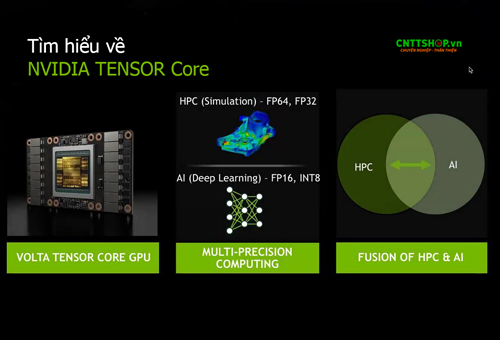

- Tensor Cores: NVIDIA tích hợp Tensor Cores, các đơn vị xử lý chuyên dụng, vào các GPU cao cấp của mình, như dòng RTX và các GPU dành cho trung tâm dữ liệu (ví dụ: dòng A và H). Tensor Cores được thiết kế đặc biệt để tăng tốc các phép toán ma trận, nền tảng cốt lõi của nhiều thuật toán học sâu, giúp GPU NVIDIA đạt được hiệu suất và hiệu quả năng lượng vượt trội trong các tác vụ huấn luyện và suy luận mô hình AI.

- Hiệu năng vượt trội: Trong các tác vụ AI đòi hỏi hiệu suất tính toán cao, đặc biệt là huấn luyện các mô hình AI khổng lồ, các GPU cao cấp nhất của NVIDIA thường chứng minh được sức mạnh vượt trội so với các đối thủ từ AMD.

- Ưu điểm:

- Hiệu năng cao, đặc biệt trong các tác vụ huấn luyện mô hình lớn.

- Hệ sinh thái CUDA trưởng thành và được tối ưu hóa sâu sắc cho AI.

- Nhiều tính năng phần cứng chuyên dụng cho AI, như Tensor Cores.

- Được hỗ trợ rộng rãi bởi các phần mềm thương mại và giải pháp AI doanh nghiệp.

- Nhược điểm:

- Giá thành cao.

- CUDA là nền tảng độc quyền, gây ra lo ngại về vendor lock-in.

AMD: “Kẻ thách thức” với giá trị trên hiệu năng

AMD đang nỗ lực khẳng định vị thế của mình trong thị trường GPU cho AI với các GPU kiến trúc RDNA và nền tảng phần mềm ROCm (Radeon Open Compute).

- ROCm: ROCm là một nền tảng phần mềm mã nguồn mở của AMD, cung cấp các công cụ và thư viện cần thiết để chạy các ứng dụng hiệu năng cao trên GPU AMD. ROCm hỗ trợ các framework AI phổ biến như TensorFlow và PyTorch, cho phép các nhà phát triển sử dụng GPU AMD cho các tác vụ AI training một cách hiệu quả.

- Giá cả cạnh tranh: Một trong những ưu điểm lớn nhất của GPU AMD là giá cả phải chăng hơn so với các sản phẩm tương đương của NVIDIA. Điều này giúp AMD trở thành một lựa chọn hấp dẫn cho các doanh nghiệp nhỏ, startup hoặc các nhà nghiên cứu độc lập có ngân sách hạn chế.

- Ưu điểm:

- Giá thành cạnh tranh, mang lại giá trị trên hiệu năng tốt.

- ROCm là nền tảng mã nguồn mở, mang lại sự linh hoạt và khả năng tùy chỉnh cao.

- Hiệu năng ngày càng được cải thiện trong các tác vụ AI.

- Nhược điểm:

- Hệ sinh thái ROCm chưa trưởng thành bằng CUDA.

- Hiệu năng thường thấp hơn so với NVIDIA trong các tác vụ đòi hỏi hiệu suất cao nhất.

- Nỗ lực thu hẹp khoảng cách: AMD đang tích cực phát triển và cải thiện ROCm để thu hẹp khoảng cách với CUDA. Các phiên bản ROCm gần đây đã đạt được những tiến bộ đáng kể về hiệu năng và khả năng tương thích, giúp AMD cạnh tranh tốt hơn với NVIDIA trong một số ứng dụng AI.

- AMD Radeon™ RX 9000 Series GPUs, được cung cấp bởi kiến trúc AMD RDNA™ 4, giới thiệu AI accelerators (bộ tăng tốc AI) thế hệ thứ 2, mang lại những cải tiến đáng kể so với AMD Radeon™ RX 7000 series (kiến trúc AMD RDNA™ 3) về khả năng, hiệu quả và thông lượng. Những cải tiến này làm cho kiến trúc AMD RDNA™ 4 trở thành một “cỗ máy” cho các khối lượng công việc machine learning, tối ưu hóa hiệu suất tính toán và xử lý dữ liệu cho các ứng dụng AI thế hệ tiếp theo.

Tóm tắt so sánh

| Tính năng | NVIDIA | AMD |

|---|---|---|

| Hệ sinh thái | CUDA (độc quyền, trưởng thành, tối ưu hóa sâu) | ROCm (mã nguồn mở, đang phát triển) |

| Hiệu năng | Cao, đặc biệt trong huấn luyện mô hình lớn | Tốt, giá trị trên hiệu năng cao |

| Giá cả | Cao | Cạnh tranh |

| Tính năng chuyên dụng | Tensor Cores | AI Accelerators (mới) |

| Ưu điểm | Hiệu năng, hệ sinh thái, hỗ trợ rộng rãi | Giá trị, linh hoạt, mã nguồn mở |

| Nhược điểm | Giá, vendor lock-in | Hệ sinh thái chưa trưởng thành, hiệu năng có thể thấp hơn trong một số trường hợp |

Phần 2: Các yếu tố quan trọng khi lựa chọn GPU cho AI

Khi lựa chọn GPU cho các ứng dụng AI, có một số yếu tố quan trọng cần xem xét:

- Hiệu suất tính toán (Compute Performance): Đây là yếu tố quan trọng nhất, đặc biệt đối với các tác vụ huấn luyện mô hình. Hiệu suất tính toán thường được đo bằng TFLOPS (Tera Floating-point Operations Per Second – Số phép toán dấu phẩy động trên giây).

- NVIDIA thường dẫn đầu về hiệu suất tính toán thô, nhưng AMD đang dần thu hẹp khoảng cách.

- Bộ nhớ VRAM (Video RAM): Dung lượng VRAM rất quan trọng, đặc biệt khi làm việc với các mô hình lớn và tập dữ liệu khổng lồ. GPU cần đủ VRAM để chứa toàn bộ mô hình và dữ liệu trong quá trình huấn luyện hoặc suy luận.

- Các GPU cao cấp của NVIDIA và AMD đều có dung lượng VRAM lớn, lên đến hàng chục hoặc thậm chí hàng trăm GB.

- AMD thường có lợi thế về dung lượng VRAM trong cùng phân khúc giá.

- Băng thông bộ nhớ: Băng thông bộ nhớ (memory bandwidth) xác định tốc độ truyền dữ liệu giữa GPU và VRAM. Băng thông bộ nhớ cao là rất quan trọng để tránh nghẽn cổ chai trong quá trình xử lý dữ liệu.

- Các GPU sử dụng bộ nhớ HBM (High Bandwidth Memory) thường có băng thông bộ nhớ cao hơn so với các GPU sử dụng bộ nhớ GDDR.

- Khả năng mở rộng: Nếu bạn có kế hoạch sử dụng nhiều GPU để tăng tốc quá trình huấn luyện, hãy xem xét khả năng mở rộng của nền tảng.

- NVIDIA NVLink là một công nghệ kết nối tốc độ cao cho phép nhiều GPU giao tiếp trực tiếp với nhau với băng thông cực lớn.

- Hỗ trợ phần mềm: Đảm bảo rằng GPU bạn chọn được hỗ trợ tốt bởi các framework AI và thư viện bạn định sử dụng.

- NVIDIA CUDA được hỗ trợ rộng rãi, nhưng AMD ROCm cũng đang ngày càng được nhiều framework AI hỗ trợ.

- Ngân sách: GPU cho AI có thể có giá từ vài trăm đến hàng chục nghìn đô la. Hãy xác định ngân sách của bạn và tìm kiếm GPU phù hợp nhất trong phạm vi đó.

- AMD thường cung cấp các tùy chọn hiệu quả về chi phí hơn so với NVIDIA.

- Khả năng tương thích: Chọn GPU tương thích với hệ thống hiện có của bạn, bao gồm cả bo mạch chủ, nguồn điện và hệ thống làm mát.

- Tiêu thụ điện năng và làm mát: GPU hiệu suất cao có thể tiêu thụ nhiều điện năng và tạo ra nhiều nhiệt. Hãy đảm bảo rằng hệ thống của bạn có đủ khả năng cung cấp điện và làm mát cho GPU.

Phần 3: So sánh chi tiết các dòng GPU phổ biến cho AI (2026)

Dưới đây là so sánh chi tiết giữa một số dòng GPU phổ biến của NVIDIA và AMD, phù hợp cho các ứng dụng AI trong năm 2026 (thông tin có thể thay đổi theo thời gian):

NVIDIA

- Dòng Data Center (ví dụ: H200, B200): Đây là những GPU mạnh mẽ nhất của NVIDIA, được thiết kế đặc biệt cho các trung tâm dữ liệu, nghiên cứu khoa học và các tác vụ AI/HPC quy mô lớn.

- Ưu điểm: Hiệu suất tính toán cao nhất, VRAM lớn (HBM3e), NVLink, độ tin cậy cao.

- Nhược điểm: Giá thành rất cao.

- Dòng RTX Professional (ví dụ: RTX 6000 Ada Generation, RTX PRO 6000 Blackwell): Đây là các GPU workstation cao cấp, phù hợp cho các chuyên gia AI, nhà nghiên cứu và nhà phát triển.

- Ưu điểm: Hiệu suất tốt, VRAM lớn (GDDR6X hoặc GDDR7), hỗ trợ các tính năng chuyên nghiệp.

- Nhược điểm: Giá thành cao.

- Dòng GeForce RTX (ví dụ: RTX 5090, RTX 5080): Đây là các GPU gaming cao cấp, cũng có thể được sử dụng cho các tác vụ AI cơ bản, học tập và thử nghiệm.

- Ưu điểm: Hiệu suất tốt, giá cả hợp lý hơn so với các dòng chuyên dụng.

- Nhược điểm: VRAM có thể hạn chế đối với các mô hình lớn, không có các tính năng chuyên nghiệp.

AMD

- Dòng Instinct (ví dụ: MI300X, MI450): Đây là các GPU dành cho trung tâm dữ liệu của AMD, cạnh tranh với dòng NVIDIA Data Center.

- Ưu điểm: Giá cả cạnh tranh, VRAM lớn (HBM3E), ROCm mã nguồn mở.

- Nhược điểm: Hiệu suất có thể thấp hơn so với NVIDIA trong một số trường hợp, hệ sinh thái ROCm chưa trưởng thành bằng CUDA.

- Dòng Radeon RX (ví dụ: RX 9070 XT, RX 7900 XTX): Đây là các GPU gaming cao cấp của AMD, cũng có thể được sử dụng cho các tác vụ AI cơ bản và học tập.

- Ưu điểm: Giá cả phải chăng, VRAM lớn, hiệu năng gaming tốt.

- Nhược điểm: Hiệu năng ray tracing có thể thấp hơn so với NVIDIA, hỗ trợ phần mềm có thể hạn chế hơn.

Bảng so sánh thông số kỹ thuật (tham khảo)

| GPU | Kiến trúc | VRAM | Băng thông bộ nhớ | FP32 TFLOPS | Tensor Cores/AI Accelerators | NVLink/Infinity Fabric |

|---|---|---|---|---|---|---|

| NVIDIA H200 | Hopper | 141GB HBM3e | 4.8 TB/s | 67 | Có | Có |

| NVIDIA RTX 6000 Ada | Ada Lovelace | 48GB GDDR6X | 1.15 TB/s | 91 | Có | Không |

| NVIDIA RTX 5090 (dự kiến) | Blackwell | ? | ? | ? | Có | Không |

| AMD Instinct MI300X | CDNA3 | 192GB HBM3 | 5.3 TB/s | 67 | Có | Có |

| AMD Radeon RX 9070 XT (dự kiến) | RDNA4 | ? | ? | ? | Có | Không |

| AMD Radeon RX 7900 XTX | RDNA3 | 24GB GDDR6 | 960 GB/s | 61 | Có | Không |

Lưu ý: Thông số kỹ thuật có thể thay đổi. Hãy tham khảo thông tin từ nhà sản xuất để có thông tin chính xác nhất.

Phần 4: Các use case điển hình và lựa chọn GPU phù hợp

Việc lựa chọn GPU phù hợp phụ thuộc vào use case cụ thể của bạn:

- Huấn luyện mô hình lớn (LLM, mô hình đa phương thức): Cần GPUData Center với VRAM lớn (HBM), hiệu suất tính toán cao và NVLink (NVIDIA H200, AMD Instinct MI300X).

- Nghiên cứu và phát triển AI: GPU workstation cao cấp với hiệu suất tốt, VRAM đủ lớn và hỗ trợ các tính năng chuyên nghiệp (NVIDIA RTX 6000 Ada Generation, AMD Radeon RX 7900 XTX).

- Suy luận AI: GPU với hiệu suất trên mỗi watt tốt, hỗ trợ các công cụ tối ưu hóa suy luận (NVIDIA Tesla T4, NVIDIA RTX A4000).

- AI cá nhân, học tập: GPU gaming cao cấp với giá cả hợp lý (NVIDIA GeForce RTX 4090, AMD Radeon RX 7900 XT).

- AI cho doanh nghiệp vừa và nhỏ:

- NVIDIA: RTX 4090 x2 / RTX 5090 x2 / RTX 6000 Ada / RTX PRO 6000.

- AI Workstation chuyên nghiệp:

- NVIDIA: 2 – 4x RTX 5880 Ada / 2 – 4x RTX PRO 6000 + CPU Threadripper / Xeon.

Kết luận

Trong cuộc chiến GPU cho AI, cả NVIDIA và AMD đều có những điểm mạnh và điểm yếu riêng. NVIDIA tiếp tục dẫn đầu về hiệu suất và hệ sinh thái phần mềm, trong khi AMD mang đến giá trị trên hiệu năng tốt hơn và sự linh hoạt của nền tảng mã nguồn mở. Lựa chọn GPU phù hợp phụ thuộc vào nhu cầu cụ thể, ngân sách và mức độ ưu tiên các yếu tố như hiệu suất, tính năng và khả năng mở rộng.

Trong tương lai, khi AI ngày càng phát triển và các mô hình trở nên phức tạp hơn, cuộc cạnh tranh giữa NVIDIA và AMD sẽ tiếp tục thúc đẩy sự đổi mới và mang lại những giải pháp phần cứng mạnh mẽ hơn cho cộng đồng AI. Người dùng nên theo dõi sát sao các xu hướng công nghệ và đánh giá kỹ lưỡng các lựa chọn trước khi đưa ra quyết định đầu tư.

Các xu hướng trong tương lai:

- Kiến trúc chiplet: Thiết kế chiplet, trong đó các thành phần được chia thành nhiều chip nhỏ hơn, có thể giúp giảm chi phí sản xuất và cải thiện khả năng mở rộng.

- Bộ nhớ HBM4: Thế hệ bộ nhớ HBM tiếp theo hứa hẹn băng thông bộ nhớ cao hơn nữa, cho phép xử lý dữ liệu nhanh hơn và hiệu quả hơn.

- Tối ưu hóa phần mềm: NVIDIA và AMD sẽ tiếp tục tối ưu hóa phần mềm của mình để tận dụng tối đa hiệu suất của phần cứng, thu hẹp khoảng cách giữa hiệu suất lý thuyết và hiệu suất thực tế.

- Sự trỗi dậy của các đối thủ mới: Các công ty khởi nghiệp và các nhà sản xuất chip khác đang tham gia vào thị trường GPU cho AI, mang đến những giải pháp sáng tạo và cạnh tranh.

Máy văn phòng

Máy văn phòng Mainboard – Bo Mạch Chủ

Mainboard – Bo Mạch Chủ RAM – Bộ Nhớ Trong

RAM – Bộ Nhớ Trong HDD – SSD – NAS

HDD – SSD – NAS PSU- Nguồn Máy Tính

PSU- Nguồn Máy Tính Case – Vỏ Máy Tính

Case – Vỏ Máy Tính Tản Nhiệt

Tản Nhiệt